Suscribete a nuestro Newsletter

Una tecnología de Google abre la puerta a la traducción automática de la lengua de signos

Un equipo de Google ha estado meses trabajando en un sistema de detección del movimiento y posición de las manos que abre la puerta al desarrollo de tecnología que pueda traducir automáticamente la lengua de signos, lo que supondría un enorme impulso para la comunicación de personas con discapacidad auditiva.

- Lectura Fácil

Google crea una tecnología que detecta el movimiento de las manos.

Esta tecnología de Google permitiría crear sistema que traduzcan de forma automática la lengua de signos.

La lengua de signos es la forma de comunicarse que utilizan muchas personas con discapacidad auditiva.

Juanan Sánchez / Foto: Google

Para impulsar esta apuesta, Google ha decidido ofrecer este sistema en código abierto a través de la plataforma MediaPipe, para que cualquier desarrollador pueda trabajar en nuevas aplicaciones y herramientas.

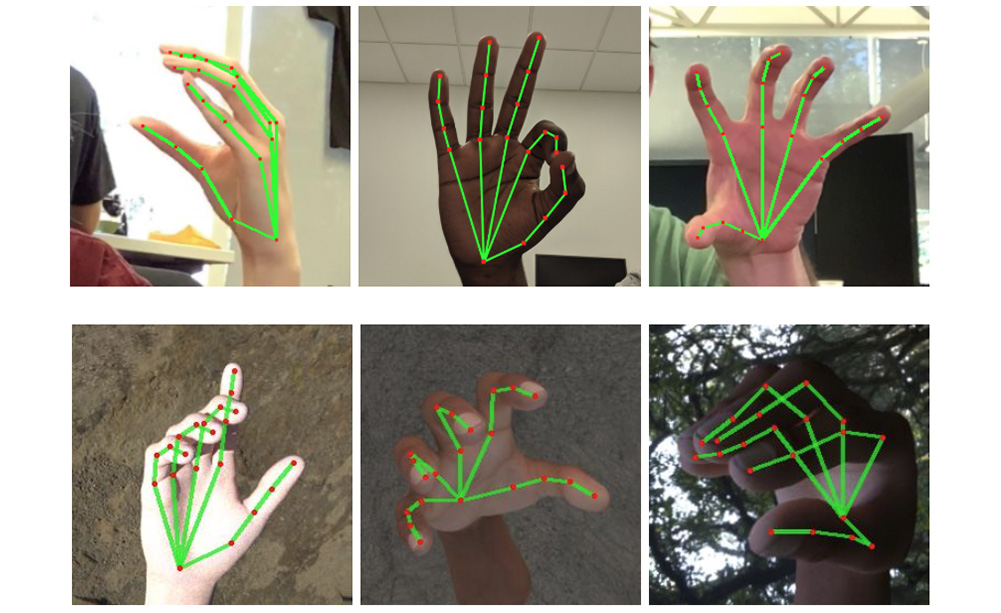

Google explica que, aunque el sistema es similar, la detección del movimiento de la mano es más complicada que el de la cara, debido a las mayores dificultades para localizar puntos de referencia que sirvan para analizar el movimiento.

Mientras que una cara tiene puntos de contraste más evidentes, como los ojos o la boca, en la mano es mucho más complicado buscar esas referencias.

El sistema de Google se basa en un detector de la palma de la mano, llamado BlazePalm, que es capaz de señalizar esta parte del cuerpo incluso aunque esté parcialmente tapada. Para ello utiliza una triple tecnología que incrementa el éxito del sistema.

Una vez localizada la palma de la mano, el sistema trabaja con el movimiento de los dedos para detectar la posición en cada momento, lo que abre la puerta a la utilización como traductor de lengua de signos.

Para lograr un mayor desarrollo de este sistema, la compañía ha decidido que esté disponible para todos los desarrolladores a través de la plataforma MediaPipe.

Categorias:

Noticias Relacionadas

-

Bastones inteligentes para personas ciegas que ayudan a elegir dónde sentarse Un equipo de la Universidad de Colorado en Boulder (Estados Unidos) está desarrollando una tecnología que permite a los bastones que utilizan las personas con discapacidad visual dar más información a su usuario y facilitarles algunos aspectos de su día a día como hacer la compra o elegir dónde sentarse en un lugar público.

Bastones inteligentes para personas ciegas que ayudan a elegir dónde sentarse Un equipo de la Universidad de Colorado en Boulder (Estados Unidos) está desarrollando una tecnología que permite a los bastones que utilizan las personas con discapacidad visual dar más información a su usuario y facilitarles algunos aspectos de su día a día como hacer la compra o elegir dónde sentarse en un lugar público. -

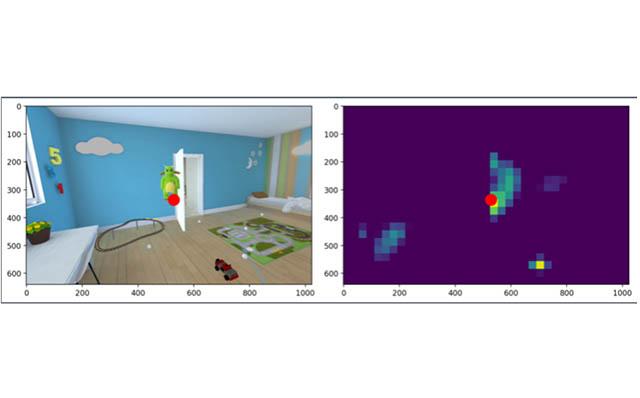

La realidad virtual que ayuda a detectar TDAH a través de un videojuego El análisis del movimiento ocular mientras los niños juegan a un videojuego puede facilitar la detección del trastorno por déficit de atención e hiperactividad (TDAH), según han demostrado científicos de las universidades finlandesas de Aalto, Helsinki y Abo Akademi.

La realidad virtual que ayuda a detectar TDAH a través de un videojuego El análisis del movimiento ocular mientras los niños juegan a un videojuego puede facilitar la detección del trastorno por déficit de atención e hiperactividad (TDAH), según han demostrado científicos de las universidades finlandesas de Aalto, Helsinki y Abo Akademi. -

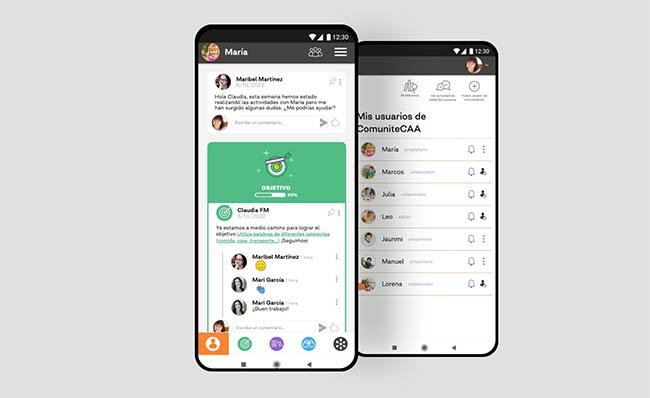

Una app para mejorar las habilidades de comunicación de personas con TEA Fundación Orange ha presentado la aplicación ComuniteCAA, una app cuyo objetivo es el de ayudar a las personas con trastorno del espectro autista (TEA) o con una discapacidad similar a mejorar su habilidad de comunicación a través de la tecnología.

Una app para mejorar las habilidades de comunicación de personas con TEA Fundación Orange ha presentado la aplicación ComuniteCAA, una app cuyo objetivo es el de ayudar a las personas con trastorno del espectro autista (TEA) o con una discapacidad similar a mejorar su habilidad de comunicación a través de la tecnología. -

Una Game Jam para crear videojuegos accesibles a personas con discapacidad visual La desarrolladora GameKonea y el Grupo Social ONCE celebrarán a partir del 20 de junio la primera Game Jam del mundo centrada en la acccesibilidad de la tecnología, con el objetivo de impulsar la creación de videojuegos accesibles a personas con discapacidad visual.

Una Game Jam para crear videojuegos accesibles a personas con discapacidad visual La desarrolladora GameKonea y el Grupo Social ONCE celebrarán a partir del 20 de junio la primera Game Jam del mundo centrada en la acccesibilidad de la tecnología, con el objetivo de impulsar la creación de videojuegos accesibles a personas con discapacidad visual. -

Huawei premia un asistente por voz y una tecnología para personas con discapacidad Huawei ha entregado sus Premios Huawei Challenge en el marco del ‘hackathon’ HackUPC2022 con los que ha distinguido la labor de los desarrolladores que han creado un asistente por voz, una aplicación para mejorar el acceso a la información de las personas con discapacidad visual y un videojuego.

Huawei premia un asistente por voz y una tecnología para personas con discapacidad Huawei ha entregado sus Premios Huawei Challenge en el marco del ‘hackathon’ HackUPC2022 con los que ha distinguido la labor de los desarrolladores que han creado un asistente por voz, una aplicación para mejorar el acceso a la información de las personas con discapacidad visual y un videojuego.

Con la ayuda de:

Entidad de referencia:

Agregar comentario